Notice

Recent Posts

Recent Comments

Link

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

Tags

- 코딩테스트

- 알고리즘

- Datastructure

- 그리디알고리즘

- 문자열

- 데이터마이닝

- greedy

- 백준

- 수학

- 그래프탐색

- DP알고리즘

- DFS

- 프로그래머스

- Baekjoon

- 코테

- 문제풀이

- 정렬

- 반복문

- 그래프

- 파이썬

- 다이나믹프로그래밍

- 깊이우선탐색

- 자료구조

- PYTHON

- 그리디

- 큐

- solvedac

- 너비우선탐색

- BFS

- dp

Archives

- Today

- Total

nyunu

[데이터 마이닝] ANN 본문

728x90

강의 출처) 2023-1 숙명여자대학교 소프트웨어학부 강의 "데이터마이닝및분석", 이기용 교수님

" Forward Propagation -> Backward Propagation -> gradient descent " 과정의 반복

1. Forward Propagation

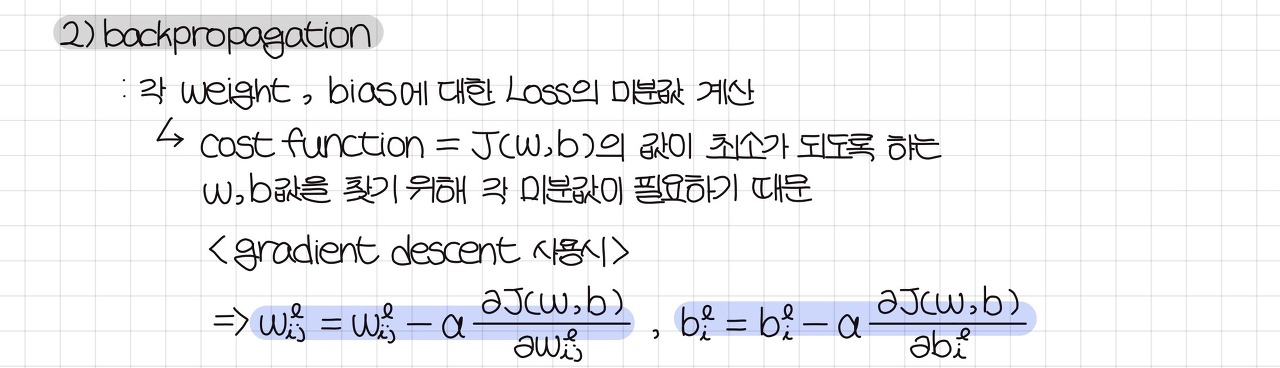

2. Backward Propagation

1) 기본 Concept

-> J(w,b) = objective function 을 최소화시키고자 함

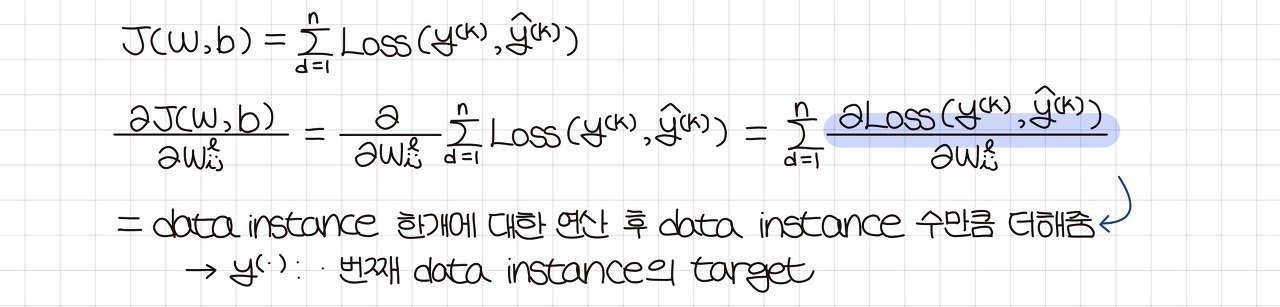

2) Weight에 대해 J(w,b) 미분

-> J(w,b) = objective function 를 최소화하는 weight의 값을 찾고자 하는 것

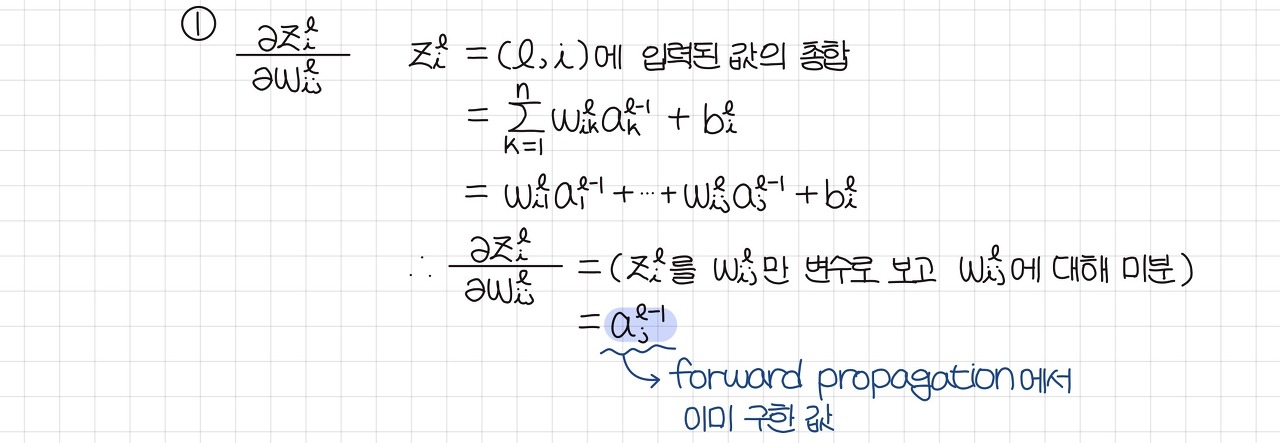

(1) J(w,b) 식을 분할 - 1

(2) J(w,b) 식을 분할 - 2

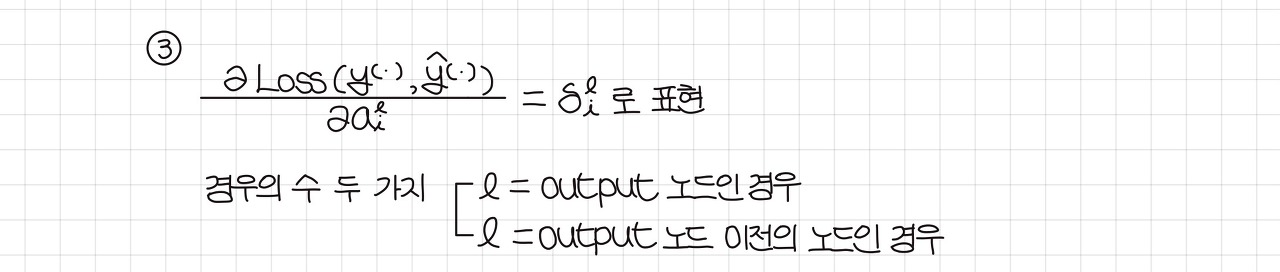

(3) J(w,b) 식을 분할 - 3

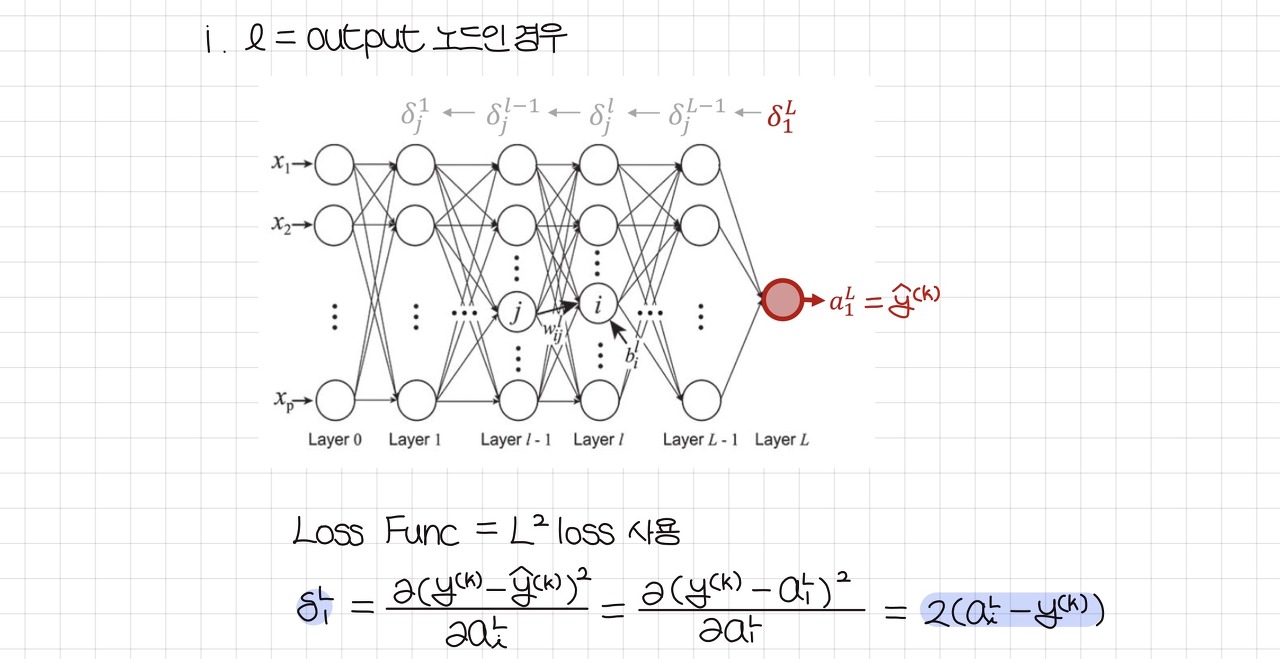

- 구하려는 델타값의 레이어 == output 레이어인 경우

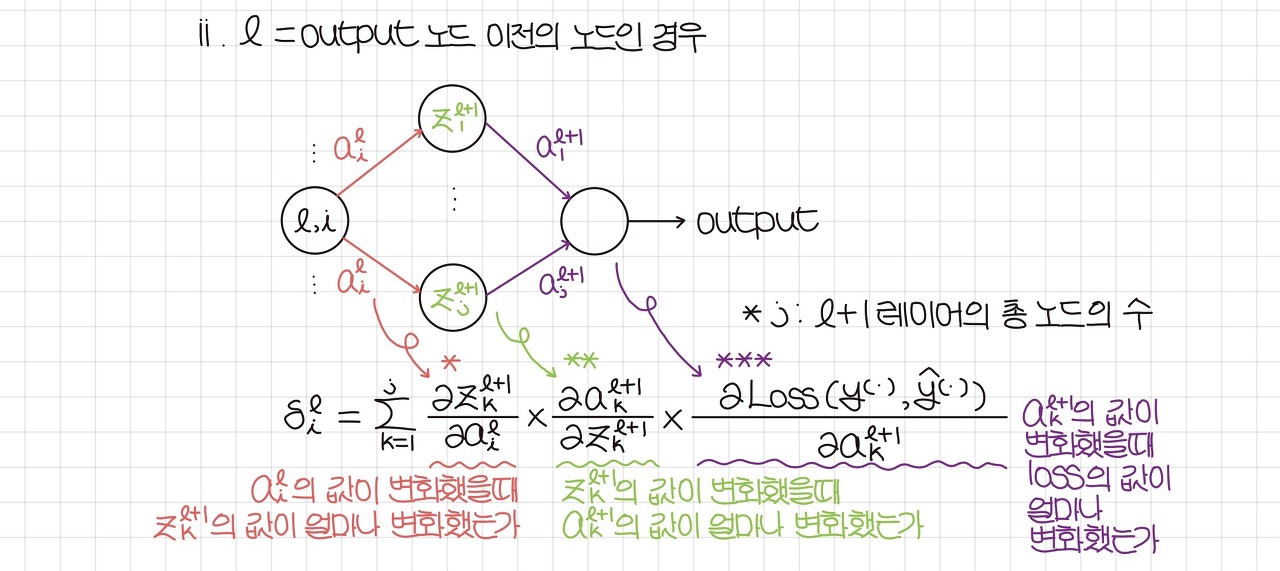

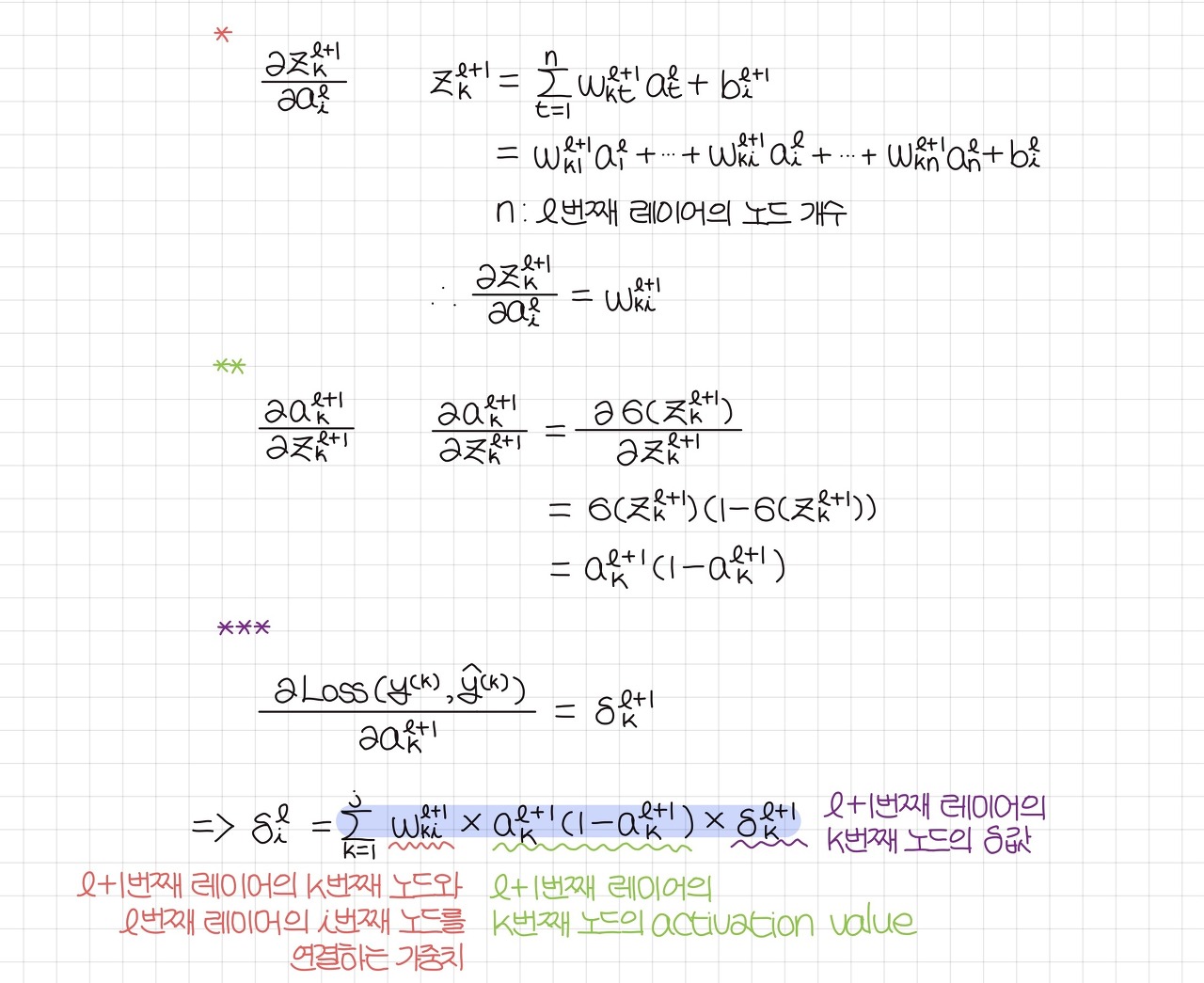

- 구하려는 델타값의 레이어 != output 레이어인 경우

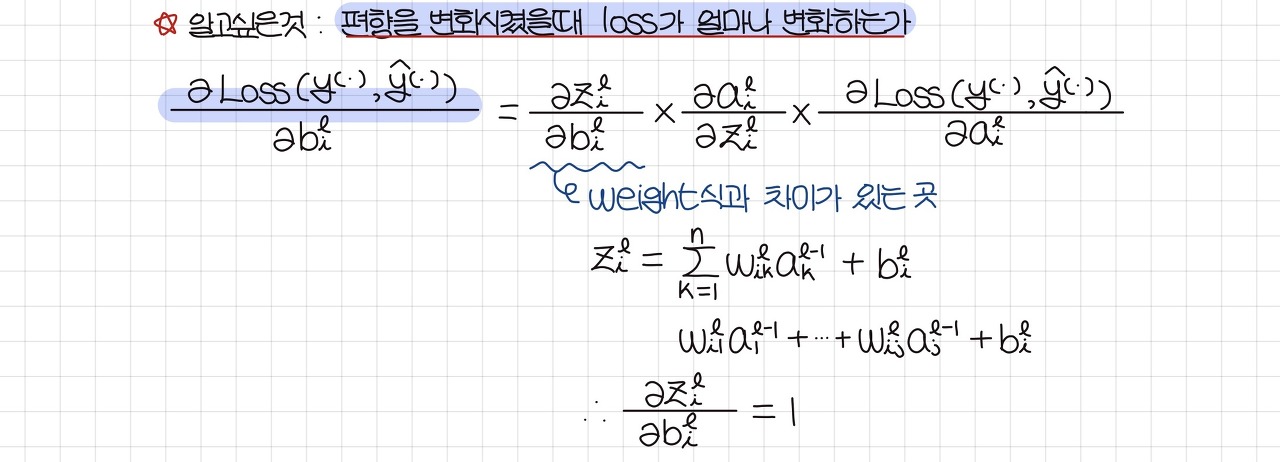

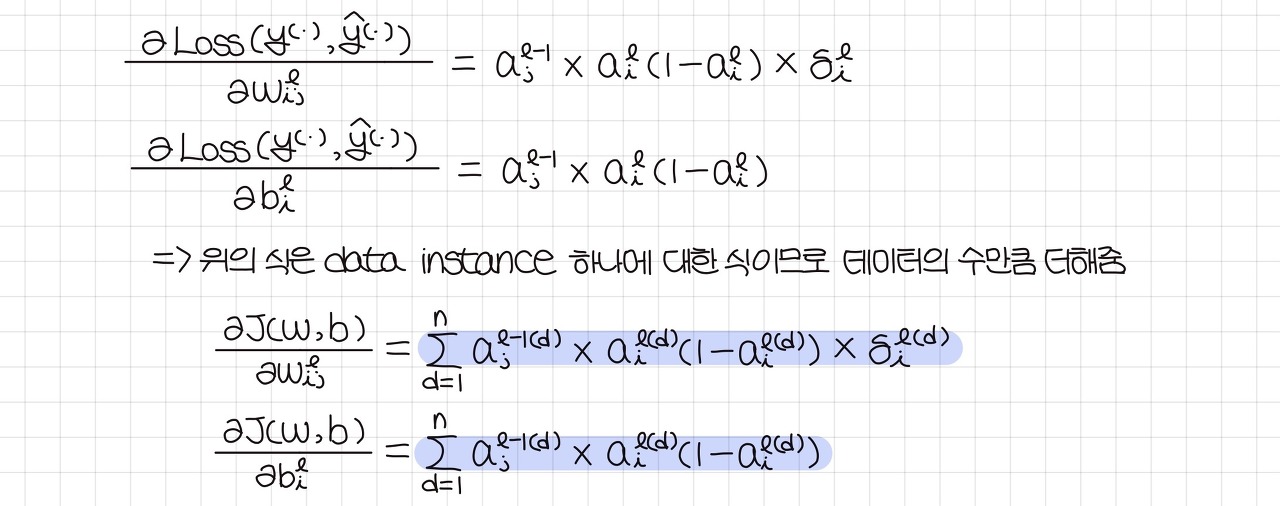

3) Bias에 대해 J(w,b) 미분

-> J(w,b) = objective function 를 최소화하는 bias의 값을 찾고자 하는 것

4) Weigt, bias로 미분한 결과

5) 전체 과정 정리

3. Gradient Descent

728x90

'Data mining' 카테고리의 다른 글

| [데이터 마이닝] 연관 분석 (Association Analysis) - 기본 개념 (0) | 2023.07.30 |

|---|---|

| [데이터 마이닝] 자기조직화지도(Self-Organizing Map, SOM) - 기본 개념 (0) | 2023.07.01 |

| [데이터 마이닝] 앙상블(ensemble) - Random Forest / multi class (0) | 2023.06.18 |

| [데이터 마이닝] 앙상블(ensemble) - Bagging, Boosting (1) | 2023.06.18 |

| [데이터 마이닝] 앙상블 (ensemble) - 기본 개념 (1) | 2023.06.18 |